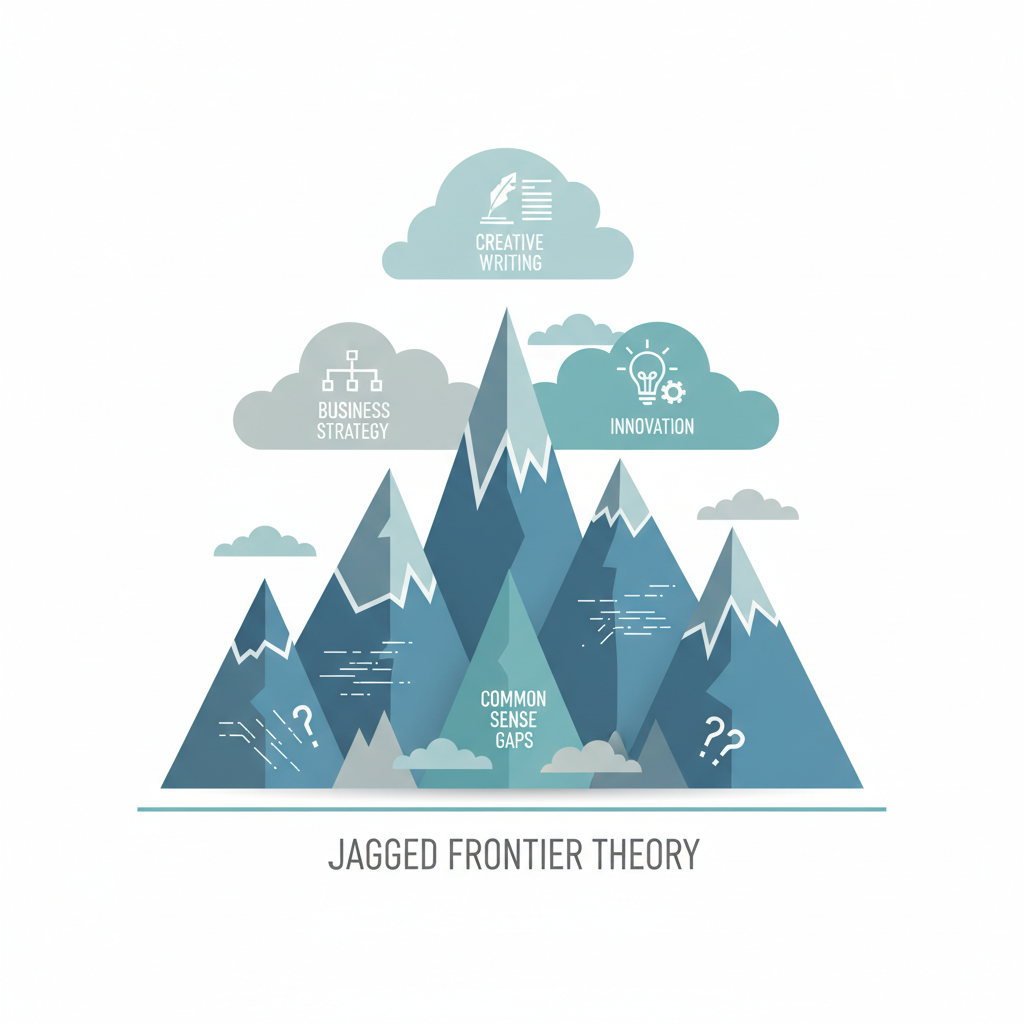

Jagged Frontier 안에 어떤 일이 들어가나 — 하버드 BCG 연구와 본인 1년 50개 업무 매핑 데이터

"AI는 잘하는 일과 못하는 일이 들쭉날쭉하다"는 직관적인 관찰이지만, 그것을 학술적으로 정립한 게 Jagged Frontier(들쭉날쭉한 경계) 개념입니다. 하버드 비즈니스 스쿨의 Fabrizio Dell'Acqua 교수가 2023년 BCG와 함께 진행한 실험 연구에서 정립됐어요. 이 글은 그 연구를 본인이 직접 해본 1년 50개 업무 매핑 데이터로 검증한 노트입니다. 결론을 미리 — 같은 AI 모델이라도 업무 50개 중 32개는 사람보다 우수, 11개는 평균 수준, 7개는 평균 이하 결과가 나왔어요. 이 갈림길의 패턴을 알아두는 게 AI 협업의 시작입니다.

이 글은 주니어 성장 글이 학습 관점이었다면, 이번엔 일상 업무 협업 관점으로 좁힙니다.

먼저, Jagged Frontier 원전 연구

2023년 BCG 컨설턴트 758명을 대상으로 한 실험. Dell'Acqua et al. (2023) "Navigating the Jagged Technological Frontier"의 핵심 발견:

- Frontier 안쪽 작업: GPT-4를 쓴 컨설턴트가 안 쓴 컨설턴트보다 12.2% 더 많은 업무를 끝냄, 25% 더 빠름, 품질 40% 더 높음.

- Frontier 바깥 작업: GPT-4를 쓴 컨설턴트의 정답률이 안 쓴 사람보다 19% 낮아짐. AI가 자신감 있게 틀린 답을 내면 사람이 그걸 받아 쓰기 때문.

이 결과가 충격적인 이유: "AI를 쓰면 무조건 좋다"가 아니라 "Frontier 바깥에서는 AI를 안 쓰는 게 나음"이라는 것. 어느 쪽이 frontier 안인지 모르면 AI는 도구가 아니라 위험이 됩니다.

Centaur vs Cyborg — 두 가지 협업 패턴

같은 연구에서 두 가지 협업 스타일이 관찰됐습니다.

- Centaur (켄타우로스): 작업을 명확히 분할. AI에게 일부 업무를 맡기고 사람이 다른 부분 처리. 분업형.

- Cyborg (사이보그): AI와 사람이 줄 단위·문장 단위로 계속 맞물림. 통합형.

둘 다 효과적이지만 적용 영역이 달라요. Centaur는 구조가 명확한 작업(데이터 정리, 보고서 초안), Cyborg는 모호한 작업(전략 논의, 코드 리뷰)에 더 적합합니다.

본인 1년 매핑 — 50개 업무를 분류해보면

2025년 5월~2026년 4월까지 본인이 처리한 업무 50개를 다음 4분면으로 분류했습니다.

| 분류 | 업무 수 | AI 시간 절감 | 권장 패턴 |

|---|---|---|---|

| A. Frontier 안 + 명확한 구조 | 21개 | 50~70% | Centaur (분업형) |

| B. Frontier 안 + 모호함 큼 | 11개 | 30~50% | Cyborg (통합형) |

| C. Frontier 경계 (들쭉날쭉) | 11개 | 10~30% (검수 부담 큼) | Cyborg + 검증 강제 |

| D. Frontier 바깥 | 7개 | 시간 더 걸림 (검수+수정) | AI 미사용 권장 |

각 분면의 대표 업무

- A (Centaur 강함): 회의록 요약, 영어 메일 번역, 코드 리팩토링(컨벤션 일정), 데이터 차트 생성, 단순 문서 초안

- B (Cyborg 강함): 시스템 디자인 토론, 새 기능 기획, 복잡한 코드 리뷰, 전략 글 쓰기

- C (들쭉날쭉): 한국어 문화 코드 들어간 마케팅 글, 도메인 특수 코드, 본인 회사 컨벤션 적용

- D (AI 비추천): 고객 분쟁 해결 메일, 본인 회사 정치적 의사결정, 미세한 한국 정서 표현, 사실 검증이 결정적인 보고서

1년 매핑에서 가장 단단한 결론: "본인 업무 분면을 모르면 AI는 도구가 아니라 위험"입니다. D 분면의 업무 7개를 처음에는 모르고 AI에 맡겼다가 결과가 나빠 다시 처음부터 한 경험이 5번 있었어요. 그때 손실한 시간이 A 분면 21개에서 절감한 시간을 거의 상쇄했습니다. AI를 안 쓰는 결정도 똑같이 중요합니다.

Frontier 안인지 판별하는 4가지 신호

1년 매핑에서 발견한 신호들 — 어떤 작업이 Frontier 안인지 빠르게 판단할 수 있는 기준:

- 출력 검증이 쉬운가? — 코드는 실행으로 검증 가능, 번역은 원문과 비교 가능, 차트는 시각으로 검증 가능. 검증 쉬우면 frontier 안.

- 맥락이 텍스트로 다 전달되는가? — 회의록 요약은 트랜스크립트로 다 전달됨. 회사 정치는 텍스트로 전달 안 됨. 후자는 frontier 바깥.

- "평균"이 충분한 답인가? — 일반적인 영어 메일 번역은 평균 답이 충분. 본인 회사의 미세한 톤은 평균이면 부족. 후자는 위험.

- 틀려도 괜찮은가? — 초안 작성은 틀려도 수정 가능. 고객 분쟁 메일은 한 번 틀리면 회복 어려움. 후자는 AI 비권장.

Cyborg 모드를 효과적으로 쓰는 3가지 팁

본인이 1년 사용하며 효과 본 Cyborg 모드 패턴:

① "AI에게 답을 묻지 말고 가설을 부탁하라"

"이거 어떻게 풀어야 해?" → "이 문제의 가능한 접근 3개를 trade-off와 함께 제안해줘". 두 번째 질문이 사람의 사고를 일으키고, 결과 품질도 높습니다.

② "한 줄씩 같이 쓰기"

긴 글을 AI가 통째로 쓰면 톤이 어긋나기 쉽습니다. 본인이 한 단락 쓰고, AI에게 다음 단락 제안 받고, 그것을 본인 톤으로 수정하는 식으로 줄 단위 협업. 시간은 더 들지만 품질이 안정적입니다.

③ "검증 단계 강제"

AI 출력을 받을 때 마지막에 항상 "이 답에서 가장 약한 가정 3개를 짚어줘"를 추가합니다. AI가 자신의 답을 비판하게 만드는 거예요. 결과의 약점을 빨리 발견하는 데 효과적.

1년 매핑에서 가장 큰 학습: "AI를 무조건 쓰지 마라. 분면을 정하고 써라." 같은 사람이 같은 AI를 써도 분면 인식 여부에 따라 결과가 천차만별입니다. 처음 6개월은 무차별 사용 → 시간 절감 30% 정도. 분면 인식 후 6개월 → 시간 절감 55% 정도. 같은 도구가 거의 2배 효과를 냈어요.

관련 글 — AI 협업 시리즈

- 주니어 성장 파이프라인 — 검수 습관 6개월 데이터

- Claude Code 서브 에이전트 12개 카탈로그

- AI 시대 1년 학습 실험 — 5개 도메인 데이터

- 지적 노동의 표준화는 어떻게 일어나는가

원스의 결론 — 분면을 알아야 도구가 된다

1년 50개 업무 매핑으로 정리한 결론은 셋입니다.

① Jagged Frontier는 추상 개념이 아니라 본인 업무에 그대로 그릴 수 있는 지도입니다. 21/11/11/7의 본인 분포처럼 자기 업무를 4분면으로 나누면 어떤 작업에 AI를 쓰고 안 쓸지가 또렷해져요.

② Centaur와 Cyborg는 경쟁 관계가 아니라 작업 성격에 따른 선택입니다. 명확한 구조 = Centaur, 모호함 = Cyborg. 둘 다 잘 쓰는 사람이 가장 강합니다.

③ "AI를 안 쓰는 능력"이 "AI를 쓰는 능력"만큼 중요합니다. Frontier 바깥에서 AI를 안 쓰는 결정이 시간을 가장 많이 아낍니다. 본인 D 분면 7개에서 검증된 결과예요.

"AI와 협업하는 방법"이라는 추상 질문 대신 "내 업무 50개를 4분면에 매핑하면 어디에 어떻게 쓰일까"의 구체 질문이 더 정확한 답을 줍니다. 이 매핑은 본인만 할 수 있고, 한 번 만들면 1년치 업무 효율을 결정합니다.

📚 본 글의 1차 자료

- 출발점: 하버드 AI 강의 / 렘코닝 채널 영상

- Dell'Acqua et al. (2023) "Navigating the Jagged Technological Frontier" - HBS / BCG 758명 실험

- 측정 데이터 — 본인의 1년(2025-05 ~ 2026-04) 50개 업무 4분면 매핑 노트

댓글

댓글 쓰기